-

Use Cases

-

Resources

-

Pricing

andiocampo

Events

CHARLES BABBAGE

1822 - 1871

% complete

Charles Babbage sentó los principios básicos de las computadoras modernas, como el concepto de programa o instrucciones básicas, que se introducen en la máquina de manera independiente de los datos, el uso de la memoria para retener resultados y la unidad aritmética.

En 1833 completó su "máquina diferencial", capaz de calcular los logaritmos e imprimirlos de 1 a 100,000 ,y formuló los fundamentos teóricos de cualquier autómata de cálculo.

se inclino en el proyecto de realizar una "máquina analítica" que fuese capaz de realizar cualquier secuencia de instrucciones aritméticas. Para esta realización contó con fondos del gobierno inglés y con la colaboración de la que está considerada como la primera programadora de la historia

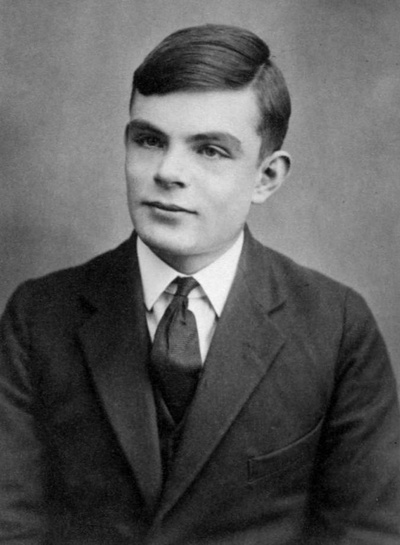

ALAN TURING

1937 - 1954

% complete

Turing demostró que había problemas irresolubles, es decir, sin solución algorítmica. Para dar forma al concepto ideó la famosa máquina que lleva su nombre, un dispositivo imaginario que, una vez construido, podría ejecutar cualquier operación matemática resoluble por medio de un algoritmo, y que, en el caso de programarse, se transformaría en un ordenador. Pero Turing jamás llegó a materializar su proyecto, al no contar con los medios técnicos necesarios.

La contribución del equipo que dirigió Turing en Bletchley Park fue crucial para el desenlace de la guerra a favor de los aliados.

En 1947 Turing pasó a dirigir el Computing Machine Laboratory de Manchester, donde desarrolló un nuevo ordenador, el MADAM (o Manchester Mark I). Era una computadora que almacenaba un programa en su memoria principal, pero que tenía más capacidad que su antecesora.

Turing estaba muy interesado en la inteligencia artificial, en el modo de imitar artificialmente las funciones del cerebro humano. Con todo, su mejor contribución en este campo volvió a ser en el ámbito teórico, con el estudio Computering Machinering and Intelligence (Máquinas de computación e inteligencia, 1950). En él, Turing establecía las bases de la inteligencia artificial y proponía un tipo de prueba, el test de Turing, para determinar si una máquina es inteligente o no.

algunas de las aportaciones de Turing son; la máquina de Turing,máquina universal de Turing, el concepto de hipercomputación, pilot Model ACE.

Bombe es un dispositivo electromecánico para uso específico: descifrar los mensajes que el ejército alemán cifraba con Enigma en la Segunda Guerra Mundial. Las máquinas se empezaron a construir en fábrica y entraron en funcionamiento en la primavera de 1940. En 1943 las ‘bombas’ ya descifraban un total de 84.000 mensajes de Enigma al mes.

su función era llevar a cabo una búsqueda sistemática basada en ciertas consideraciones lógicas, y así encontrar partes de las claves Enigma que se habían utilizado para cifrar los mensajes interceptados. Estas claves se cambiaron regularmente al menos una vez al día.

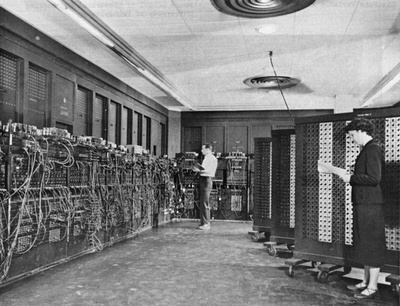

1 GENERACION

1945 - 1956

% complete

La computadora fue utilizada para fines militares durante la Seguna Guerra Mundial.

IBM creó la primera calculadora electrónica en 1944.

Se desarrolló la computadora ENIAC (Electronic Numerical Integrator and Computer), EDVAC (Electronic Discrete Variable Automatic Computer) en 1945 y la UNIVAC (Universal Automatic Computer)en 1951.

Lo más significativo de esta generación fue el uso de los tubos al vacío

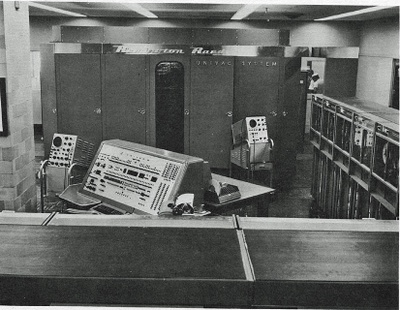

2 GENERACION

1956 - 1963

% complete

Se remplazaron los tubos al vacío por los transistores.

Se reemplazó el lenguaje de máquina por el lenguaje ensamblador.

Se crearon los lenguajes de alto nivel como COBOL (Common Business-Oriented Language) y FORTRAN (Formula Translator).

Se diseñaron computadoras más pequeñas, rápidas y eficientes.

SMARTPHONES, INTERNET, REDES INALAMBRICAS

1960 - 2020

% complete

El primer smartphone de la historia fue el IBM Simon, fabricado en 1992 y distribuido por EEUU.

Los primeros smartphones combinaron funciones de asistente digital personal (PDA) con cámara de fotos y navegador GPS, pero ahora incluyen conexión a internet vía WIFI o red móvil para la navegación por la web, videollamadas, visionado de correo electrónico (E-Mail), reproductor

multimedia, etc…

El primer teléfono al que, se le dio el nombre de smartphone fue el Ericsson GS88, apodado ‘Pamela’, que fue desarrollado en 1997 por la casa Ericsson, disponía del sistema operativo de 16 bit GEOS de GeoWorks, el mismo que se adoptó en los Nokia 9000/9110 , traía de serie correo electrónico POP3, SMS, reloj mundial y navegador entre otros. Se podía poner en modo de vuelo desactivando todas las comunicaciones inalámbricas. Tenía manos libres integrado, módem integrado, puerto de infrarrojos, conexión al pc por medio de RS232 (conocido popularmente como cable serie) y teclado QWERTY físico.

Es posible que el “boom” y el empuje comercial de estos dispositivos tuviera lugar en el 2000 con la aparición del sistema operativo Windows Mobile, actualmente conocido por su versión más reciente llamada Windows Phone.

1971 cuando un grupo de investigadores bajo la dirección de Norman Abramson, en la Universidad de Hawaii, crearon el primer sistema de conmutación de paquetes mediante una red de comunicación por radio, dicha red se llamo ALOHA. Ésta es la primera red de área local inalámbrica (WLAN), estaba formada por 7 computadoras situadas en distintas islas que se podían comunicar con un ordenador central al cual pedían que realizara cálculos.

En 1999 Nokia y Symbol Technologies crearon la asociación Wireless Ethernet Compatibility Alliance (WECA), que en 2003 fue renombrada a WI-FI Alliance (WIreless FIdelity), el objetivo de ésta fue crear una marca que permitiese fomentar más fácilmente la tecnología inalámbrica y asegurar la compatibilidad de equipos.

En el 2000, la WECA certificó según la norma 802.11b (revisión del 802.11 original) que todos los equipos con el sello WI-FI podrán trabajar juntos sin problemas.

Los inicios de Internet nos remontan a los años 60. En plena guerra fría, Estados Unidos crea una red exclusivamente militar, con el objetivo de que, en el hipotético caso de un ataque ruso, se pudiera tener acceso a la información militar desde cualquier punto del país.

Esta red se creó en 1969 y se llamó ARPANET. En principio, la red contaba con 4 ordenadores distribuidos entre distintas universidades del país.

Tanto fue el crecimiento de la red que su sistema de comunicación se quedó obsoleto. Entonces dos investigadores crearon el Protocolo TCP/IP, que se convirtió en el estándar de comunicaciones dentro de las redes informáticas (actualmente seguimos utilizando dicho protocolo).

3 GENERACION

1964 - 1971

% complete

Uso de chips de silicón./Sistemas operativos.

Circuitos Integrados, Compatibilidad con Equipo Mayor, Multiprogramación, Minicomputadora

Las computadoras de la tercera generación emergieron con el desarrollo de los circuitos integrados (pastillas de silicio) en las cuales se colocan miles de componentes electrónicos, en una integración en miniatura. Las computadoras nuevamente se hicieron más pequeñas, más rápidas, desprendían menos calor y eran energéticamente más eficientes.

La IBM 360 una de las primeras computadoras comerciales que usó circuitos integrados, podía realizar tanto análisis numéricos como administración ó procesamiento de archivos. Los clientes podían escalar sus sistemas 360 a modelos IBM de mayor tamaño y podían todavía correr sus programas actuales. Las computadoras trabajaban a tal velocidad que proporcionaban la capacidad de correr más de un programa de manera simultánea (multiprogramación).

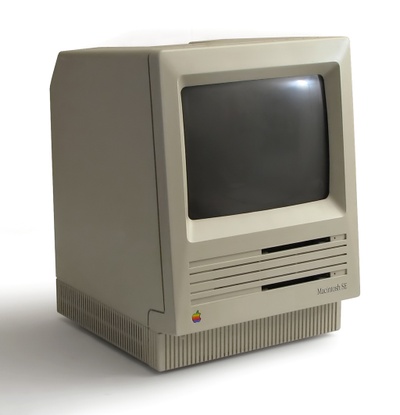

4 GENERACION

1971 - 2019

% complete

Se desarrollaron nuevos chips con mayor capacidad de almacenamiento.

Se comenzaron a utilizar las computadoras personales y las Macintosh.

Se desarrolló el diseño de redes.

Internet

STEVE JOBS/ BILL GATES

1975 - 2020

% complete

Bill Gates fue unos de los primeros en hacer Software para los primeros ordenadores de la historia y es el creador del sistema operativo más usado del mundo (Windows).

Empresario y filántropo estadounidense, cofundador de la empresa de software Microsoft. Creó la empresa de Software Microsoft el 4 de abril de 1975, siendo aún alumno en la Universidad de Harvard.

Steve Jobs, fue un empresario y magnate de los negocios del sector informático.

Fundó Apple en 1976 junto con un amigo de la adolescencia, Steve Wozniak, en el garaje de su casa. Entre sus inventos también destacan el ipod, el itunes y Macintosh 128k.

Las aportaciones de Jobs.

1.Las computadoras Apple. Nacieron como la competencia natural de las PC. En un inicio, los productos Apple se caracterizaron por su bajo costo, pero sobre todo por ser muy amigables con el usuario.

2.Pixar. Esta empresa de animación surgió con el nombre de NeXT, Jobs compró a George Lucas una compañía de animación en 50 millones de dólares, que más tarde se convertiría en Pixar.

3.iPod. La música registró un gran cambio con la salida de este dispositivo para almacenar música. En 2001, se lanzó la primera generación, la música se digitalizó formalmente, se lanzó el formato iTunes y con esto lograron consolidar el negocio de descarga de canciones de manera legal.

4.iPhone. El primer teléfono inteligente con pantalla touch, vio la luz en enero del 2007. El dispositivo fue presentado como tres en uno: era un iPod touch, un teléfono y un navegador de internet móvil. A partir de esta fecha comenzaría un reinado en el mercado de los teléfonos inteligentes.

5.iPad. La tableta fue lanzada en 2010, un dispositivo parecido al iPod, pero de mayor tamaño. Jobs diseñó el iPad desde los años ochenta, y lo veía como una computadora personal del tamaño de un libro. El objetivo del iPad era brindar una experiencia más íntima con el usuario.

5 GENERACION

1978 - 2020

% complete

La quinta generación de computadoras es como se designa a la etapa que abarca desde el año 1983 hasta la actualidad, un periodo donde las computadoras son veloces y eficientes y poseen un desarrollado software modernos.los aparatos electrónicos son pequeños, delgados y fáciles de transportar permitiendo además el almacenamiento de información multimedia en dispositivos sólidos y tarjetas de memoria de gran capacidad.

hace referencia a un ambicioso proyecto japonés llevado a cabo en la década de los años 70 a cargo del Ministerio de Comercio Internacional e Industria.

Dicho proyecto tenía por objetivo elaborar un nuevo tipo de computadoras que fueran capaces de utilizar técnicas y tecnologías de inteligencia artificial, así como de implementar un hardware y software avanzados.

DEFINICIONES

1980 - 2020

% complete

BIT es la unidad mínima de información empleada en informática, en cualquier dispositivo digital, o en la teoría de la información. Con él, podemos representar dos valores cualquiera, como verdadero o falso, abierto o cerrado, blanco o negro, norte o sur, masculino o femenino, rojo o azul, etc. Basta con asignar uno de esos valores al estado de "apagado" y el otro al estado de "encendido"

BYTE es la unidad de información de base utilizada en computación y en telecomunicaciones, y que resulta equivalente a un conjunto ordenado de ocho bits

Un byte es una unidad de información formada por una secuencia de bits adyacentes. El diccionario de la Real Academia Española señala que byte es sinónimo de octeto (una unidad de información de ocho bits); sin embargo, el tamaño del byte depende del código de caracteres en el que ha sido definido

CARÁCTER es una unidad de información que corresponde aproximadamente con un grafema o con una unidad o símbolo parecido, como los de un alfabeto o silabario de la forma escrita de un lenguaje natural.

Un ejemplo de carácter es una letra, un número o un signo de puntuación. El concepto también abarca a los caracteres de control, que no se corresponden con símbolos del lenguaje natural sino con otros fragmentos de información usados para procesar textos, tales como el retorno de carro y el tabulador, así como instrucciones para impresoras y otros dispositivos que muestran dichos textos.

ASCII; código estándar estadounidense para el Intercambio de Información ,pronunciado generalmente áski , es un código de caracteres basado en el alfabeto latino, tal como se usa en inglés moderno. Fue creado en 1963 por el Comité Estadounidense de Estándares como una evolución de los conjuntos de códigos utilizados entonces en telegrafía. Más tarde, en 1967, se incluyeron las minúsculas, y se redefinieron algunos códigos de control para formar el código conocido como US-ASCII.

El código ASCII utiliza 7 bits para representar los caracteres, aunque inicialmente empleaba un bit adicional (bit de paridad) que se usaba para detectar errores en la transmisión. A menudo se llama incorrectamente ASCII a varios códigos de caracteres de 8 bits que extienden el ASCII con caracteres propios de idiomas distintos al inglés, como el estándar ISO/IEC 8859-1.1

ASCII fue publicado como estándar por primera vez en 1967 y fue actualizado por última vez en 1986. En la actualidad define códigos para 32 caracteres no imprimibles, de los cuales la mayoría son caracteres de control que tienen efecto sobre cómo se procesa el texto, más otros 95 caracteres imprimibles que les siguen en la numeración.

Casi todos los sistemas informáticos actuales utilizan el código ASCII o una extensión compatible para representar textos y para el control de dispositivos que manejan texto como el teclado.