-

Use Cases

-

Resources

-

Pricing

andrea garcia

Events

conceptos basicos

800 - 1963

% complete

-800:Origen y definicion de algoritmo

Por el origen de la palabra, que se remonta al siglo IX, la respuesta correcta es algoritmo, con el sonido suave de la ere. En ese entonces, al servicio del califa El-Mamoun, se encontraba un matemático que fue autor de obras de astronomía, geografía, y álgebra. Su nombre era Al-Khawarizmi, y junto con su legado de conocimientos dejó al morir, en el año 840, un método para resolver problemas matemáticos.

El término algoritmo, que manejamos hoy día para cualquier procedimiento (no solamente matematico), tuvo más caminos por recorrer. En el siglo XVII en Francia sufre un cambio en su forma de escribirse al moderno "algorithm". Seguramente y equivocadamente al relacionarlo al griego "arithmos" (números). De allí es tomado por el idioma Ingles, y luego regresará al español.

Es en el siglo XVIII-XIX que toma su utilización actual y más general. El "algoritmo" no solo se aplica en procedimientos matemáticos. Se puede definir por lo tanto como toda clase de procedimientos utilizados con el propósito de resolver problemas o realizar determinadas tareas.

Con la aparición de las primeras computadoras programables en el siglo XX y su posterior masificación, el concepto de algoritmo pasa a quedar relacionado fuertemente con las computadoras.

UNIDADES DE MEDICION

Kilobyte (K o KB).- Aunque se utilizan las acepciones utilizadas en el SI, un Kilobyte no son 1.000 bytes. Debido a lo anteriormente expuesto, un KB (Kilobyte) son 1.024 bytes. Debido al mal uso de este prefijo (Kilo, proveniente del griego, que significa mil), se está utilizando cada vez más el término definido por el IEC (Comisión Internacional de Electrónica) Kibi o KiB para designar esta unidad.

Megabyte (MB).- El MB es la unidad de capacidad más utilizada en Informática. Un MB NO son 1.000 KB, sino 1.024 KB, por lo que un MB son 1.048.576 bytes. Al igual que ocurre con el KB, dado el mal uso del término, cada vez se está empleando más el término MiB.

Gigabyte (GB).- Un GB son 1.024 MB (o MiB), por lo tanto 1.048.576 KB. Cada vez se emplea más el término Gibibyte o GiB.

Llegados a este punto en el que las diferencias sí que son grandes, hay que tener muy en cuenta (sobre todo en las capacidades de los discos duros) que es lo que realmente estamos comprando. Algunos fabricantes utilizan el termino GB refiriéndose no a 1.024 MB, sino a 1.000 MB (SI), lo que representa una pérdida de capacidad en la compra.

Terabyte (TB).- Aunque es aún una medida poco utilizada, pronto nos tendremos que acostumbrar a ella, ya que por poner un ejemplo la capacidad de los discos duros ya se está aproximando a esta medida.

Un Terabyte son 1.024 GB. Aunque poco utilizada aun, al igual que en los casos anteriores se está empezando a utilizar la acepción Tebibyte

-REFERENCIAS-

Podberezski, V., (19 de noviembre, 2018). Recuperado de:

http://inside-the-trash-can.blogspot.com/2018/11/sobre-el-algoritmo-su-origen-y.html

https://definiciona.com/algoritmo/

-1948: Origen y definicion de BIT

En 1948, Bell Laboratories anunció la creación del bit, una unidad para medir la información. Su inventor tenía 32 años y se llamaba Claude Shannon. La idea de Shannon era contrauitiva y revolucionaria: según él, los mensajes no siempre tienen sentido, y que lo tengan o no son "aspectos semánticos de la comunicación... irrelevantes para el problema de ingeniería".

Bit es la abreviación de Binary Digit (digito binario), la cual en términos técnicos es la menor unidad de información de una computadora. Un bit tiene solamente un valor (que puede ser 0 o 1). Varios bits combinados entre sí dan origen a otras unidades, como “byte”, “mega”, “giga” y “tera”.

Toda la información procesada por una computadora es medida y codificada en bits. El tamaño de los archivos son medidos en bits, las tasas de transferencia son medidas en bit, toda la información en el lenguaje del usuario es convertida a bits para que la computadora la «entienda».

-REFERENCIAS-

https://definicion.mx/bit/

https://www.xatakaciencia.com/computacion/la-invencion-del-bit-la-particula-fundamental-de-la-informacion

-1956: Origen y definicion del byte

El byte fue utilizado por primera vez por el Dr. Werner Buccholz, un científico que trabajaba en IBM como una unidad de información digital equivalente a cuatro bits (binary digit, dígito binario) originalmente y posteriormente como estándar se adoptó que 1 byte equivale a ocho bits. La palabra byte proviene de bite, que significa mordisco, como la cantidad más pequeña de datos que un ordenador podía "morder" a la vez.

Es un conjunto de 8 bits, formando según una secuencia que representa un carácter. Se puede hacer una correspondencia biunívoca entre cada número decimal (0 a 9), las letras mayúsculas y minúsculas (A hasta Z), los símbolos matemáticos, la puntuación, y demás símbolos, con un respectivo byte.

-REFERENCIAS-

https://www.significados.com/byte/

Sanchez, N., (30 de septiembre, 2010). Recuperado de: https://tecnologyc.com/la-historia-de-los-bits-y-los-bytes/

-1962: informatica

El término informática proviene del francés informatique, implementado por el ingeniero Philippe Dreyfus a comienzos de la década del ’60. El término Informática se creó en Francia en el año 1962 bajo la denominación INFORMATIQUE y procede de la contracción de las palabras INFORmation autoMATIQUE. Posteriormente fue reconocido por el resto de países, siendo adoptado en España en 1968 bajo el nombre de INFORMMICA que, como puede deducirse fácilmente, viene de la contracción de las palabras INFORmación autoMATTCA, En los países anglosajones se conoce con el nombre de Computer Science.

a informática se refiere al procesamiento automático de información mediante dispositivos electrónicos y sistemas computacionales. Los sistemas informáticos deben contar con la capacidad de cumplir tres tareas básicas: entrada (captación de la información), procesamiento y salida (transmisión de los resultados). El conjunto de estas tres tareas se conoce como algoritmo.

La informática reúne a muchas de las técnicas que el hombre ha desarrollado con el objetivo de potenciar sus capacidades de pensamiento, memoria y comunicación.

-REFERENCIA-

http://ifdmmginformatica.blogspot.com/2008/10/definicion-y-origen-del-termino.html

https://tecnologia-informatica.com/informatica-que-es/

-1963: Origen del caracter ASCII

Esta herramienta usada por casi todos los ordenadores del mundo actualmente, tiene sus raíces en la segunda guerra mundial. Allá por 1945 la telegrafía necesitaba de un código estándar para transmitir la información. La compañía Bell desarrolló su propio sistema para poder transmitir mensajes de una manera standard a través del telégrafo. Y menos de veinte años después, en 1963, el Comité Estadounidense de Estándares constituyó el código ASCII oficialmente. En un primer momento solo incluía El código ASCII tiene sus raíces allá por la segunda guerra mundialletras mayúsculas y números; cuatro años más tarde se añadieron las letras minúsculas y algunos caracteres más, formando lo que conocemos como US-ASCII.

En su momento Bell pensó en emplear un código de 6 "bits" es decir, una combinación de 6 ceros y unos (parecida a esta: 001001) derivado de lo que se conocía como Fieldata que a su vez procede de un código más antiguo desarrollado por Baudot. Junto a Baudot, Bell se unió a la Agencia Americana de Estándares (o ASA) y juntos desarrollaron el actual código ASCII. A diferencia del viejo código morse, el nuevo y flamante código de Bell y la ASA era mucho más ordenado, constante y eficiente. Aunque de primeras pudiera parecer menos intuitivo, el código morse tampoco lo era. Desde su publicación, en 1963, el código ASCII ha sido revisado varias veces a lo largo de su vida, añadiendo caracteres y combinaciones de dígitos. En 1967 se incluyeron las letras minúsculas, por ejemplo y la última revisión se hizo en 1986.

-REFERENCIAS-

UNAM, (2018). Recuperado de: http://informatica.dgenp.unam.mx/recomendaciones/codigo-ascii

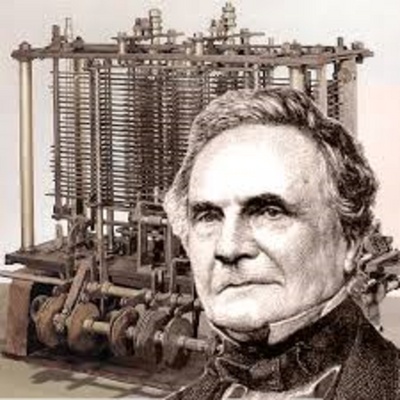

Charles Babbage y la maquina en diferencias.

1819 - 1871

% complete

-1819: Charles Babbage comienza a trabajar en un dispositivo que pronto se convertiría en la maquina de diferencias, el cual lo ideo con la Sociedad Analítica.

La máquina estaba pensada para operar tabulando funciones polinómicas, usando notación decimal y siendo accionada por una manivela.

-1822: el motor de la maquina diferencial de Babbage

Charles obtiene un motor en diferencias funcionales y obtiene una subvención para completar la máquina de diferencias.

-1824: Medalla de oro

Charles gana la medalla de oro de la Royal Astronomical Society por su motor diferencial.

-1834: suspencion de la maquina en diferencias

Se pone en pausa debido a la falta de fondos y debido a eso comienza a la máquina analítica ideal. Deja de trabajar en la diferencial debido a que considera la mejor máquina analítica, ya que esta deberia sumar, restar, multiplicar y dividir en secuencia una razón de una operación por segundo y lo más destacable es el tamaño ya que cubre el tamaño de un campo de futbol.

-1843: Lenguaje de programacion ADA

Lady Ada Augusta Lovelace (hija de Lord Byron y colaboradora de Babbage) sugirió la idea de las tarjetas perforadas afectadas de manera que propiciaran el motor de Babbage repitiera ciertas operaciones.

-18 de octubre de 1971: muere Charles Babbage

Charles Babbage (El padre de la computación) muere a la edad de 79 años, la autopsia revelo que la muerte fue debida a una insuficiencia renal causada por cistitis.

-APORTACION-

Esta información es demasiado interesante ya que nos podemos dar cuenta como se debía de usar la maquina y sobre todo saber quienes intervinieron en la idea de Charles par poder llevar a cabo este gran proyecto. Necesitamos conocer como poco a poco se fue construyendo la máquina diferencial y con mayor interés sobre una de las partes fundamentales para el funcionamiento de la máquina como lo es el motor ya que tras obtener un motor en diferencias funcionales en 1822 y ganar una medalla honorífica de la Sociedad de Astronomía de Londres, logró una subvención para completar lo que hoy conocemos como su máquina en diferencias.

-REFERENCIA-

Joadtor: biografia de Charles Babbage. (15 de noviembre, 2011). Recuperado de: https://histinf.blogs.upv.es/2011/11/15/charles_babbage/

Menéndez, R., Barzanallana, R. (24 de septiembre de 2016). Recuperado de: https://www.um.es/docencia/barzana/BIOGRAFIAS/Historia_Babbage_01.html

https://latam.historyplay.tv/hoy-en-la-historia/fallecio-charles-babbage

Alan Turing

1936 - 1954

% complete

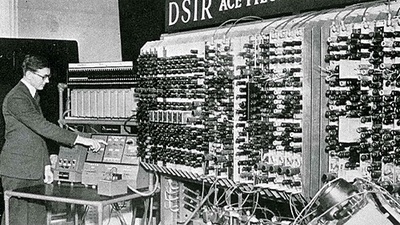

-1936:Maquina de Turing

La máquina fue presentada por Alan turing en on computable numbers with an application to the Entscheidungs Problema es el modelo matemático de un dispositivo que se comporta como un autómata finito y que dispone de una cinta de longitud infinita en la que se pueden leer, escribir o borrar símbolos.

-1950: El test de turing

Turing abordo el problema de la inteligencia artificial y propuso este test con la finalidad de que se tuviera y se intentara definir un estandar con el cual una computadora se podria llamar “inteligente”.

La idea consistía en que se puede llegar a decir que una computadora “piensa“ si un interrogador humano no pudiera distinguir a través de una conversación, si estuviera conversando con un ser humano o con una máquina. Turing propuso que en lugar de simular una mente artificial adulta, era mejor simular una mente infantil para someterla más tarde a un proceso de aprendizaje.

-1954: Muerte de Turing

Turing fue despedido de su puesto de trabajo y se sometió a una castración química mediante inyecciones de hormonas femeninas tras ser declarado culpable de tener relaciones sexuales con un hombre, un delito considerado grave en 1952. De hecho, las prácticas homosexuales fueron ilegales en el Reino Unido hasta 1967. Tras ser encarcelado y sometido a castracion quimica se suicido tras ingerir cianuro.

-APORTACION-

Es un evento muy importante debido a que se ha utilizado como generadora de lenguaje, códigos y compiladores y en tiempos atrás se utilizaba en máquinas por los criptologos británicos para poder descifrar señales cifradas por la máquina alemana durante la segunda guerra mundial y es aquí donde se comienza el cambio hacia la actualidad.

-REFERENCIAS-

Recuperado de: https://www.investigacionyciencia.es/revistas/investigacion-y-ciencia/miniceras-158/mquinas-de-turing-2271

https://www.matesfacil.com/automatas-lenguajes/Maquina-Turing.html

https://www.eldiario.es/turing/criptografia/alan-turing-enigma-codigo_0_226078042.html

https://www.genbeta.com/desarrollo/alan-turing-padre-de-la-informatica-moderna-y-paria-social

http://www.diariodeciencias.com.ar/alan-turing-vidapasion-y-muerte/

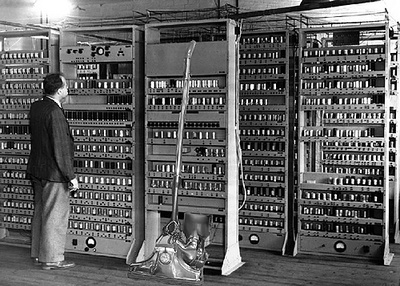

Primera generación de las computadoras

1946 - 1958

% complete

En esta época las computadoras funcionaban con válvulas, usaban tarjetas perforadas para entrar los datos y los programas, utilizaban cilindros magnéticos para almacenar información e instrucciones internas y se utilizaban exclusivamente en el ámbito científico o militar. La programación implicaba la modificación directa de los cartuchos y eran sumamente grandes, utilizaban gran cantidad de electricidad, generaban gran cantidad de calor y eran sumamente lentas.

Los principales personajes son:

John Louis von Neumann (1903-1957)

Konrad Zuse (1910-1957) El primer prototipo de computadora digital

1941 Alan M. Turing y la Collosus

Grace Hooper (1906-1992) la MARK I de IBM en 1944

-APORTACION-

Cabe destacar que la primera generacion de computadora se lanzo al mercado hasta mediados de el siglo xx y en esta epoca fueron muy importante debido a que necesitaban algo que cubriera los asuntos militares y cientificos y como era de esperarse las compútadoras eran demasiado lentas y de gran tamaño y obviamente eran muy notorias.

-REFERENCIAS-

Machado, J., (Junio,200). Recuperado de:http://colposfesz.galeon.com/hiacomp/primerag.htm

Segunda generacion de las computadoras

1959 - 1964

% complete

Características de ésta generación: Usaban transistores para procesar información. Los transistores eran más rápidos, pequeños y más confiables que los tubos al vacío. 200 transistores podían acomodarse en la misma cantidad de espacio que un tubo al vacío. Usaban pequeños anillos magnéticos para almacenar información e instrucciones. Producían gran cantidad de calor y eran sumamente lentas. Se mejoraron los programas de computadoras que fueron desarrollados durante la primera generación.

Se desarrollaron nuevos lenguajes de programación como COBOL y FORTRAN, los cuales eran comercialmente accesibles. Se usaban en aplicaciones de sistemas de reservaciones de líneas aéreas, control del tráfico aéreo y simulaciones de propósito general. La marina de los Estados Unidos desarrolla el primer simulador de vuelo,Computadora Whirlwind. Se comenzó a disminuir el tamaño de las computadoras.

Aparecen muchas compañías y las computadoras eran bastante avanzadas para su época como la serie 5000 de Burroughs y la ATLAS de la Universidad de Mánchester. Algunas computadoras se programaban con cintas perforadas y otras por medio de cableado en un tablero.

Principales personajes:

John Bardeen

Walter Brattain

William Shockley

Jack Kilby

-APORTACIONES-

Para esta generacion ya habian demasiados cambios en las tecnologias y las cosas que la diferencian de la primera son que tiene mayor velocidad, ya no se media por segundos. Sino por milisegundos, la disminucion de consumo energetico y de produccion de calor, lenguajes de programacion mas potentes y lo mas destacable, las aplicaciones comerciales en aumento para la elaboración de nóminas, facturación y contabilidad, etc.

-REFERENCIAS-

http://eduardking.mx.tripod.com/segundagen.htm

Machado, J.,(Junio, 2000). Recuperado de:http://colposfesz.galeon.com/hiacomp/segundag.htm

Tercera generacion de las computadoras

1964 - 1971

% complete

Comienza a utilizarse los circuitos integrados, lo cual permitió abaratar costos al tiempo que se aumentaba la capacidad de procesamiento y se reducía el tamaño de las máquinas. La tercera generación de computadoras emergió con el desarrollo de circuitos integrados (pastillas de silicio) en las que se colocan miles de componentes electrónicos en una integración en miniatura. El PDP-8 de la Digital Equipment Corporation fue el primer miniordenador.

Los principales creadores fueron:

Jack St. Claire Kilby

Robert Noyce

-APORTACIONES-

En mi punto de vista considero que esta generacion fue la que tuvo cambios mas trascendentes debido a que la capacidad de la memorias llegaba hasta 2 megabytes y la rapidez era de 5 millones de instrucciones por segundo y permitio la introduccion de algunos programas.

-REFERENCIAS-

Yanez, D. Recuperado de: https://www.lifeder.com/tercera-generacion-computadoras/

Cuarta generacion de computadoras

1971 - 1981

% complete

Fase caracterizada por la integración sobre los componentes electrónicos, lo que propició la aparición del microprocesador, es decir, un único circuito integrado en el que se reúnen los elementos básicos de la máquina. Se desarrolló el microprocesador. Se colocan más circuitos dentro de un "chip". "LSI - Large Scale Integration circuit". "VLSI - Very Large Scale Integration circuit". Cada "chip" puede hacer diferentes tareas. Un "chip" sencillo actualmente contiene la unidad de control y la unidad de aritmética/lógica. El tercer componente, la memoria primaria, es operado por otros "chips". Se reemplaza la memoria de anillos magnéticos por la memoria de "chips" de silicio. Se desarrollan las microcomputadoras, o sea, computadoras personales o PC. Se desarrollan las supercomputadoras.

Personaje principal: Marcial Edward

-APORTACION-

En estta generacion podemos notar que se empieza a trabajar con caracteristicas muy similares a las actuales, porque es cuando se comienza a agregar el sistema de base de datos que facilita la tarea de consulta y edicion y sobre todo las aplicaciones con las que podemos trabajar.

-REFERENCIAS-

http://eduardking.mx.tripod.com/cuartagen.htm

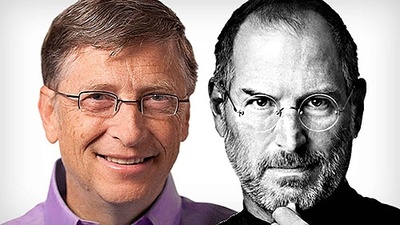

Aportaciones de Bill Gates y Steven Jobs

1975 - 1976

% complete

-1975: Aportaciones de Bill Gates.

Bill Gates fue unos de los primeros en hacer Software para los primeros ordenadores de la historia y es el creador del sistema operativo más usado del mundo (Windows).

Exactamente microsoft dio inicio el 4 de abril de 1975 esta compañía fue fundada por William H. Gates III y Paul Allen, dedicado al sector de la informática microsoft desarrolla, fabrica, licencia y produce software y equipos electrónicos. El nombre de esta empresa es el acrónimo de microcomputer software, lo que significa que no trabaja en la fabricación de ordenadores, sino los programas que permiten que el ordenador funcione, lo que todos conocemos como software.

-APORTACION-

Es importante reconocer todo el éxito que ha tenido microsoft en el mundo actual y sobre todo el que han tenido sus productos, como lo son Internet Explorer 9, Xbox Kinect, Windows 7, Windows Phone 7 y Windows Live.

-REFERENCIA-

Satya, N.,(6 de abril, 2015). Recuperado de: https://news.microsoft.com/es-es/2015/04/06/historia-microsoft-40-aniversario/

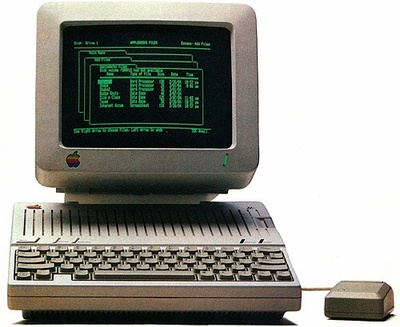

-1976: Aportaciones de Steven Jobs

Apple tiene dos creadores Steve Jobs y Steve Wozniak, ellos se conocieron en el año de 1971 pero fue hasta el año de 1976 que Jobs conoció a Mike Markkula el cual decidió invertir, y fue exactamente el 1 de abril de 1976 que se creó Apple computer a través de un contrato que tuvo un valor inicial entre 100 y 150 mil dólares y que alcanzó un valor de 1.594.500 dólares.

Algunas de sus aportaciones a la tecnologia son:

Apple

Pixar

Ipod

Iphone

Ipad

-APORTACIONES-

Es muy importante destacar que apple es una de las compañias con más éxito en la actualidad internacionalmente debido a la gran calidad que ofrecen en sus aparatos electrónicos tanto como en su sistema, es todo esto lo que ha llevado a apple a tener el éxito mundial sin dejar de lado las ganancias que adquieren año con año.

-REFERENCIAS-

http://www.asuservicio.net/p/la-increible-historia-de-apple/

https://conceptodefinicion.de/apple/

Quinta generacion de las computadoras

1982 - 1989

% complete

Es el desarrollo de una nueva clase de computadoras que utilizarían técnicas y tecnologías de inteligencia artificial tanto en el plano del hardware como del software, usando el lenguaje PROLOG al nivel del lenguaje de máquina y serían capaces de resolver problemas complejos, como la traducción automática de una lengua natural a otra. Como unidad de medida de rendimiento y prestaciones de estas computadoras se empleaba la cantidad de LIPS capaz de realizar durante la ejecución de las distintas tareas programadas.

-REFERENCIAS-

https://www.euston96.com/quinta-generacion-computadoras/

Sexta generacion de computadoras

1990

% complete

Surge la PC tal cual como la conocemos en la actualidad. IBM presenta su primera computadora personal y revoluciona el sector informativo. En vista de la acelerada marcha de la microelectrónica, la sociedad industrial se ha dado a la tarea de poner también a esa altura el desarrollo del software y los sistemas con que se manejan las computadoras. Es un periodo donde las computadoras son veloces y eficientes y poseen un desarrollado software moderno.

-APORTACIONES-

Para mi esta es la generacion con mas cambios que ha tenido ya que nos permite adquirir un ordenador lo mas pequeño posible, mas rapido, menos pesado, con mas almacenamiento, faciles de usar y con la capacidad de poder ingresar o realizar cualquier actividad dentro de ella.

-REFERENCIA-

https://tecnologia-informatica.com/generaciones-computadoras-sexta-generacion/