-

Use Cases

-

Resources

-

Pricing

karla ramirez

Events

Creación de la maquina analítica

1823

% complete

Se crea la primera computadora, la maquina analítica, por Charles Babbage, un profesor matemático de la Universidad de Cambridge. Esta idea surgió debido a que la elaboración de las tablas matemáticas era un proceso tedioso y propenso a errores.

Ésta maquina contaba con todas las partes esenciales de la computadora moderna, tales como: dispositivo de entrada, memoria, unidad central de procesamiento e impresora.

Alan Mathison Turing

1939 - 1941

% complete

Turing, uno de los padres de la ciencia de la computación y precursor de la informática moderna. Logró proporcionar una influyente formalización de los conceptos de algoritmo y computación: la máquina de Turing, formuló su propia versión de la tesis de Church-Turing.

Trabajó durante la segunda Guerra Mundial decifrando códigos nazis, especialmente los de la máquina Enigma.

Tras la Guerra, diseñó uno de los primeros computadores electrónicos programables digitales en el Laboratorio Nacional de Física del Reino Unido. Poco tiempo después, construyó otra maquina en la Universidad de Mánchester.

Turing es mayormente conocido, sobre todo, por la concepción del test de Turing, un punto de viste según el cual puede juzgarse la inteligencia de una máquina si sus respuestas en la prueba son distintas de las del ser Humano.

Todo terminó para Turing después de ser procesado por ser homosexual, después de 2 años de su condena, éste murió.

Generaciones de las Computadoras

1945 - 2019

% complete

La tecnología asociada a la primera generación de las computadoras (1945-1956) es el tubo de al vacío, tubos de vidrio que contienen electrodos, generalmente se controlaban con paneles de control con cableado o series de códigos en cintas de papel.7

La segunda generación (1956-1963) sustituyó los tubos al vacío por transistores, los cuales permitían que las computadoras fueran más reducidas de tamaño, rápidas, baratas y eficientes con la energía. Éstas computadoras dejaron atrás el lenguaje de máquinas críptico binariopara utilizar un lenguaje ensamblador.

Lo que hizo distinguir a la tercera generación (1964-1971), fue la tecnología de circuitos, un dispositivo sencillo con muchos transistores, estos se fueron haciendo más pequeños y se colocaron en chips de silicona llamados semiconductores. Durante esta generación, las computadoras utilizaban un lenguaje más avanzado como Java y JavaScript, cambió su interacción a traves de teclados, un ratón y monitores con una interfaz y un sistema operativo, así el dispositivo podia ejecutar diferentes aplicaciones al mismo tiempo con un sistema central encargado de la memoria.

Por su parte, la cuarta generación fue y es definida por los microprocesadores, el cual permite que miles de circuitos integrados sean construidos en un solo chip de silicon, ésto con la finalidad de reducir el tamaño del dispositivo y pudiera ser manejado con una sola mano, en 1971 se desarrolló el chip INTEL 4004, que localizaba todos los componentes de la computadora, en 1981, IBM creó una nuva computadora capaz de ejecutar 240,000 sumas por segundo, en 1984 Apple introdujó la Macitosh con un sistema operativo completamente distinto a Windows.

Loa chips de proceso son utilizados como procesadores centrales y los chips de memoria se utilizan para la memoria de acceso aleatorio (RAM)

La mayoría de dispositivos de la quinta generación aún se encuentran en desarrollo y se basan en la inteligencia artificial. Ésta generación se basa en hardware de procesamiento paralelo y en software de inteligencia artificial. La meta de la quinta generación es desarrollar que puedan responder al al ingreso del lenguaje natural y que sean capaces de aprender y organizarse a si mismas

ENIAC (Por Von Neumann)

1947

% complete

Se construye, en la Universidad de Pennsylvania, la ENIAC (Electronic Numerical Integrator And Calculator), primera computadora electrónica , encabezado por un equipo de diseño, los ingenieros John Mauchly y John Eckert.

Dicha máquina se encontraba bajo un sótano, tenía más de 18 mil tubos de vacío, consumía 200 KW de energía y requería de un sistema de aire acondicionado, todo esto para poder realizar más de 5 mil operaciones aritméticas en un segundo. Tenía aproximadamente 4 mil bulbos y usaba un tipo de memoria basado en tubos llenos de mercurio por donde circulaban señales eléctricas sujetas a retardos.

BIT & BYTE

1948

% complete

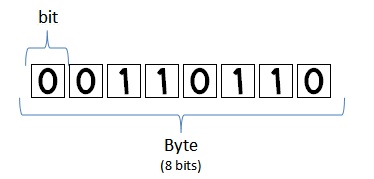

Bit es la abreviatura de Binary Digit, que es un dígito de sistema de numeración binario en donde se utilizan 2 dígitos, el 0 y el 1. Es la unidad minima de información empleada en informática, con el cual podemos representar 2 valores cualquiera, solo con asignar uno de esos valores al estado de apagado (0) y el otro al estado de encendido (1). Su inventor fue Claude Shannon.

Por otra parte, el Byte es la unidad de capacidad de almacenamiento estandar, con la cual se mide desde el almacenamiento de datos hasta la capacidad de memoria de un ordenador, representa un número y está constituido por 8 bits consecutivos, de tal modo que un Byte equivale a 8 Bits. Existen 256 combinaciones posibles. Fue Werner Buchholz quien estandarizó al Byte moderno como paquete de 8 Bits, todo esto durante el desarrollo del IBM 7030

ASCII

1963

% complete

El American Standard Code for Information Interchange (ASCII) se creó en 1963 gracias al comité Estadounidense de Estandares ("ASA" ó "ANSI") a partir de reordenar y expandir el conjunto de símbolos y caracteres ya utilizados, en aquel entonces, en la telegrafía por la compañia Bell.

Al principio solo incluía letras mayúsculas, pero fue hasta 1967 cuando se agregaron letras minusculas y algunos caracteres de control, formando lo que hoy se conoce como US-ASCII (codigos del 0 al 127).

En 1981, la empresa IBM creo una extensión de 8 Bits del código ASCII, la cual llamaron "página de código 437" donde se reemplazaron algunos caracteres de control obsoletos por caracteres gráficos, también se agregaron 128 caracteres nuevos que incluían simbolos, signos, gráficos adicionales y letras latinas, indispensables para la escritura en otros idiomas como el español.

Bill Gates & Steve Jobs

1974 - 1992

% complete

En 1974, en Palo Alto, fué ahí donde se unió a su primer socio, el ingeniero Stephen Wozniak, con el cual desntro de un garage juntos crearon el Apple 1, considerado como el primer ordenador personal de la historia.

En 1975, Gates creó la empresa de software Microsoft Corporation en Alburquerque, siendo éste su director y presidente general. Un año después (1976) Steve Jobs se encontraba comercializando el primer ordenador personal, el Apple 1, y al mismo tiempo fundando Apple Computer, una de las empresas más innovadoras del sector con el dinero obtenido de la venta, teniendo lugar en el garage de la familia Jobs, contribuyendo en la popularización de la informática.

En 1977, Gates y Jobs, comenzaron a comercializar la segunda versión de su computadora personal, el Apple ll que se vendía con un sistema operativo creado por Apple.

En 1981 Jobs cometió el error de dar a conocer información a otras empresas sobre sus aparatos, ocasionando así la separación de estos. Un año antes Gates había hecho un acuerdo con IBM para suministrar un sistema operativo adaptado a sus ordenadores personales, el "MS-DOS", que desde entonces iría instalado en todos los ordenadores de la marca.

Surgimiento de Internet

1989

% complete

En marzo de 1989 se presentó la primera propuesta de la red, surgiendo de la idea de combinar el HTTP (Protocolo de Comunicación que Permite la Transferencia de Información) y el HTML (Lenguaje Marcado para lka Generación de Páginas) la cual no obtuvo las respuestas esperadas.

Un año después (1990) Berners-Lee y su socio Robert Cailliau realizaron una revisión la propuesta original, la cual obtuvo buenos resultados y enl 6 de Agosto de 1991 se vio online la explicación de sobre la naturaleza de la Web, en la cual se explicó cómo generar un navegador y establecer un servidor Web. En 1995 ya había 200 servidores.

Tim Berners-Lee

Noviembre 1989

% complete

Tim Berners-Lee, científico de la computación británico, el padre de la web, estableció la primera comunicación entre un cliente y un servidor usando el protocolo HTTP. Él y su equipo crearon el Lenguaje HTML (HyperText Markup Language) o Lenguaje de etiquetas de hipertexto, el protocolo HTTP (HyperText Transfer Protocol) y el sistema de localización de objetos en la web URL (Uniform Resource Locator) todo esto ante la necesidad de de distribuir e intercambiar información acerca de sus investigaciones de una manera más efectiva, desarrollando así, las ideas fundamentales que estructuran la web.